Intel Core i7 (i7-8550U) が搭載されている PC が 8 万円程度で買える…、その魅力に負けて弁当箱のような小さな PC (Skynew M4S) を Amazon で買ってしまいました。

ここ数年、廉価なノート PC に Linux をインストールしてモバイルライフを愉しんでいましたが、Amazon の Fire HD 8 を入手して以来、出張が多い毎日にプライベートな用途には意外とこれで十分で、一方、自宅ではもっとパワーのある CPU で Linux を使いたいと思うようになっていました。そんなときに Intel Core i7 搭載で手頃な値段な PC に飛びついてしまったのでした。

プリインストールされている Windows 10 Pro 64bit には興味がないので、Fedora 29 を USB メモリでライブ起動できることを確認してから、そのまま SSD へインストールしてしまいました。

メモリは 8GB (DDR4-2400) 搭載されており、32GB まで増設出来るということなので、将来 増設することを見込んで、スワップ領域を 32GB に設定しました。ストレージ容量は SSD 128GB + HDD 1TB と潤沢ですが、SSD に Fedora をインストールする場合、ルートに 50GB、スワップに 32GB、ブート領域に 1GB と割り当てると、さすがに /home の領域は大して残りません。

インストール時に、/home を HDD の 1TB の領域に割当てようとしましたが、論理ボリュームを利用した状態ではうまく設定ができなかったので、やむなく、まずは SSD だけに Fedora をインストールして、インストール後に HDD 1TB を /home に追加することにしました。

今回は、/home に論理ボリュームを追加した操作を備忘録にまとめました。

論理ボリュームの追加

Fedora をインストールした後の SSD の VG (Volume Group) は以下のように fedora と private になっています。/home 用の VG には private という別の名前を付けて別にしました。

[bitwalk@localhost ~]$ sudo vgdisplay [sudo] bitwalk のパスワード: --- Volume group --- VG Name fedora System ID Format lvm2 Metadata Areas 1 Metadata Sequence No 3 VG Access read/write VG Status resizable MAX LV 0 Cur LV 2 Open LV 2 Max PV 0 Cur PV 1 Act PV 1 VG Size 82.00 GiB PE Size 4.00 MiB Total PE 20992 Alloc PE / Size 20992 / 82.00 GiB Free PE / Size 0 / 0 VG UUID FoYIVm-fxdp-Z0dQ-G4sN-sC0Q-RGHW-u1ep3s --- Volume group --- VG Name private System ID Format lvm2 Metadata Areas 1 Metadata Sequence No 2 VG Access read/write VG Status resizable MAX LV 0 Cur LV 1 Open LV 1 Max PV 0 Cur PV 1 Act PV 1 VG Size 36.23 GiB PE Size 4.00 MiB Total PE 9276 Alloc PE / Size 9276 / 36.23 GiB Free PE / Size 0 / 0 VG UUID TOCC3d-MBhO-gi4m-2QGJ-ZL1m-Ec1t-2znm8l

論理ボリュームは次のようになってます。

[bitwalk@localhost ~]$ sudo lvdisplay --- Logical volume --- LV Path /dev/fedora/root LV Name root VG Name fedora LV UUID LL7xEh-DFK1-HJaU-ukVf-ts6B-igdX-tkw4SU LV Write Access read/write LV Creation host, time localhost, 2018-12-29 03:59:09 +0900 LV Status available # open 1 LV Size 50.00 GiB Current LE 12800 Segments 1 Allocation inherit Read ahead sectors auto - currently set to 256 Block device 253:0 --- Logical volume --- LV Path /dev/fedora/swap LV Name swap VG Name fedora LV UUID ajJF5d-li76-6Sf8-vffQ-uv3w-ncRe-P8ggca LV Write Access read/write LV Creation host, time localhost, 2018-12-29 03:59:13 +0900 LV Status available # open 2 LV Size 32.00 GiB Current LE 8192 Segments 1 Allocation inherit Read ahead sectors auto - currently set to 256 Block device 253:1 --- Logical volume --- LV Path /dev/private/home LV Name home VG Name private LV UUID CpCQlV-ghBA-f655-FhdU-iJM6-Sr0o-0wobIS LV Write Access read/write LV Creation host, time localhost, 2018-12-29 03:59:13 +0900 LV Status available # open 1 LV Size 36.23 GiB Current LE 9276 Segments 1 Allocation inherit Read ahead sectors auto - currently set to 256 Block device 253:2

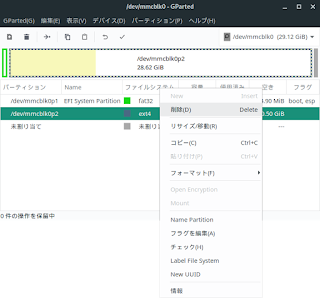

ext4 形式でフォーマットされた 1TB の HDD (/dev/sda1) を、ボリュームグループ private に追加します。

[bitwalk@localhost ~]$ sudo vgextend private /dev/sda1 WARNING: ext4 signature detected on /dev/sda1 at offset 1080. Wipe it? [y/n]: y Wiping ext4 signature on /dev/sda1. Physical volume "/dev/sda1" successfully created. Volume group "private" successfully extended

ボリュームグループを確認して、private にフリーな領域が増えていることを確認します。

[bitwalk@localhost ~]$ sudo vgdisplay --- Volume group --- VG Name fedora System ID Format lvm2 Metadata Areas 1 Metadata Sequence No 3 VG Access read/write VG Status resizable MAX LV 0 Cur LV 2 Open LV 2 Max PV 0 Cur PV 1 Act PV 1 VG Size 82.00 GiB PE Size 4.00 MiB Total PE 20992 Alloc PE / Size 20992 / 82.00 GiB Free PE / Size 0 / 0 VG UUID FoYIVm-fxdp-Z0dQ-G4sN-sC0Q-RGHW-u1ep3s --- Volume group --- VG Name private System ID Format lvm2 Metadata Areas 2 Metadata Sequence No 3 VG Access read/write VG Status resizable MAX LV 0 Cur LV 1 Open LV 1 Max PV 0 Cur PV 2 Act PV 2 VG Size 967.74 GiB PE Size 4.00 MiB Total PE 247742 Alloc PE / Size 9276 / 36.23 GiB Free PE / Size 238466 / <931.51 GiB VG UUID TOCC3d-MBhO-gi4m-2QGJ-ZL1m-Ec1t-2znm8l

論理ボリューム /dev/private/home を目一杯拡張します。

[bitwalk@localhost ~]$ sudo lvextend -l +100%FREE /dev/private/home

Size of logical volume private/home changed from 36.23 GiB (9276 extents) to 967.74 GiB (247742 extents).

Logical volume private/home successfully resized.

df で確認すると、まだ private-home (/dev/private/home) の領域は増えていません。

[bitwalk@localhost ~]$ df ファイルシス 1K-ブロック 使用 使用可 使用% マウント位置 devtmpfs 3959492 0 3959492 0% /dev tmpfs 3974644 21232 3953412 1% /dev/shm tmpfs 3974644 1672 3972972 1% /run tmpfs 3974644 0 3974644 0% /sys/fs/cgroup /dev/mapper/fedora-root 51343840 7727928 40978088 16% / tmpfs 3974644 55548 3919096 2% /tmp /dev/sdb1 999320 186364 744144 21% /boot /dev/mapper/private-home 37135824 327416 34892300 1% /home tmpfs 794928 8152 786776 2% /run/user/1000

resize2fs コマンドで private-home (/dev/private/home) の領域を拡張します。

[bitwalk@localhost ~]$ sudo resize2fs /dev/private/home

resize2fs 1.44.3 (10-July-2018)

Filesystem at /dev/private/home is mounted on /home; on-line resizing required

old_desc_blocks = 5, new_desc_blocks = 121

The filesystem on /dev/private/home is now 253687808 (4k) blocks long.

df で private-home (/dev/private/home) の領域が増えていることを確認します。

[bitwalk@localhost ~]$ df ファイルシス 1K-ブロック 使用 使用可 使用% マウント位置 devtmpfs 3959492 0 3959492 0% /dev tmpfs 3974644 21236 3953408 1% /dev/shm tmpfs 3974644 1672 3972972 1% /run tmpfs 3974644 0 3974644 0% /sys/fs/cgroup /dev/mapper/fedora-root 51343840 7727928 40978088 16% / tmpfs 3974644 55548 3919096 2% /tmp /dev/sdb1 999320 186364 744144 21% /boot /dev/mapper/private-home 998562264 347280 957230228 1% /home tmpfs 794928 8152 786776 2% /run/user/1000

にほんブログ村